Estando de acuerdo en el punto que ilustra sobre la denominación de la palabra “inteligencia” a lo que realmente es una resolución probabilistica, creo que estamos simplificando mucho el cómo funciona una IA

No creo que el experimiento de John Searle exprese cómo funciona una IA actualmente, ya que los sistemas actuales no ejecutan simplemente unas reglas predefinidas por un ingeniero, no siguen un algoritmo dado al pie de la letra, sino que son capaces de aprender y mejorar su rendimiento a partir de los datos, tomando decisiones creativas y produciendo algoritmos que en muchos casos funcionan como “caja negra” para los mismos programadores que lo están ejecutando. Lo que hacen es identificar patrones y relaciones que en muchas ocasiones ni los programadores podían ver, y por eso los ajedrecistas actuales estudian los movimientos de las IAs para aprender nuevos patrones, o genera nuevos algoritmos para multiplicar matrices

Una IA de DeepMind halla una nueva forma de multiplicar números y acelerar los ordenadores.

Si quiere no llamemos a esto “Inteligencia”, pero desde luego la capacidad que tiene una IA de generar nuevas ideas demuestra en mi opinión que la interacción con la realidad ya no está solo en los humanos que lo han creado

Tampoco estoy de acuerdo con este argumento. Hace ya bastante tiempo que las IAs son capaces de generar un etiquetado automático para entrenar al algoritmo. Por ejemplo, con el uso de redes neuronales convolucionales, que aprenden a identificar patrones complejos en imágenes y las clasifican con alta precisión.

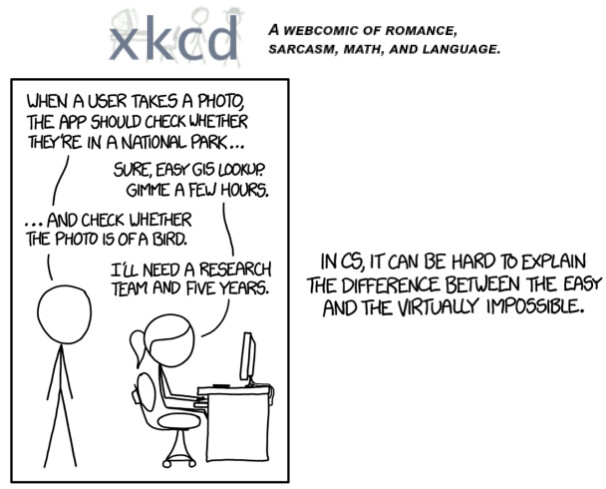

Jeremy Howard (fundador de Fast.ai, responsable de Stable Diffussion) empieza su curso de IAs con este chiste:

Lo hace porque en 2015, la idea de crear un sistema informático que reconociera pájaros automáticamente se consideraba tan desconsideradamente complejo que se consideraba humor

Sin embargo, luego procede a explicar cómo hoy en 2 minutos cualquiera de nosotros somos capaces de crear un sistema que haga precisamente eso (con un pájaro, un perro, un coche o con lo que quiera que se nos pueda ocurrir que se pueda traducir a imágenes, incluidos espectros electromagnéticos, ondas de sonido o patrones de comportamiento de un usuario en una APP del móvil).

Ya no existen humanos a céntimos etiquetando paquetes de datos*, se hacen automáticamente. Hoy las computadores pueden hacer cosas que hace unos pocos años se consideraban simplemente imposibles, y se mueve tan rápido que es imposible de predecir cómo va a ser a 2 años vista.

(*Si existen humanos pagados a céntimos evaluando la calidad de las respuestas de modelos tipo ChatGPT, para ajustarlos a patrones de respeto y sin sesgo, más aceptables por los humanos… pero esto es otra historia que daría para otro libro… e incluso esto se hace con un número sorprendentemente bajo de patrones. Ej unos 50.000 para un modelo tan bestial como un LLM tipo ChatGPT)

Justamente está pasando todo lo opuesto. Los avances de los LLM o de IAs generativas de imágenes son impresionantes precisamente porque no se están entrenando verticalmente para tareas específicas, sino que el objetivo es perseguir entrenar un modelo de IA más o menos general y comprobar dónde están los límites de qué cosas puede aprender. Ejemplos:

- GPT3 simplemente asigna a cada palabra, número o caracter un token, y lo único que está entrenado para hacer es a poner el siguiente token en una cadena, basado en probabilidad. Sin embargo con esto se ha conseguido que escriba textos con sentido y estructura, que pueda ejecutar operaciones matemáticas, que pueda programar. Todas, funciones para las que no se le ha entrenado en específico.

- Dalle2 o Stable Diffusion están entrenados para encontrar y utilizar patrones en imágenes, y reproducirlos en base a los tokens introducidos en el prompt, y ha sido capaz de generar imágenes alucinantes

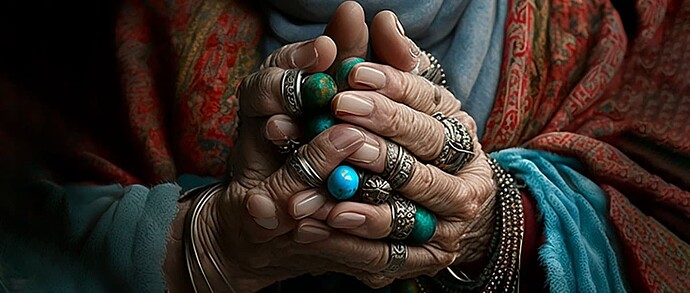

Por supuesto, todos conocemos identificamos equivocaciones flagrantes en los razonamientos, matemáticas o código escupido por estos modelos, por no hablar de las manos en las imágenes generadas por IA.

Pero justamente este de las manos es el mejor ejemplo de por dónde está evolucionando la Inteligencia Artificial: Si quisieran entrenar una IA para hacer unas manos perfectas, lo podrían hacer casi sin esfuerzo, pero no es su objetivo… el objetivo es que sin decirle nada, la IA sea capaz de aprender cómo son las manos y generar una imagen de acuerdo a ello. Y en ello están, en este y todos los demás ámbitos.

Por clarificar, no dudo que en paralelo irán cogiendo estos modelos generales para entrenarlos en tareas concretas, y que serán tremendamente exitosos en ello. Pero lo que es realmente impresionante es precisamente la evolución de los modelos más o menos generales para aprender a hacer nuevas tareas.

Es muy difícil definir esto que señala.

De hecho en muchos casos estamos ya en los casos opuestos, en los que son los humanos los que no somos capaces de entender qué razonamiento le ha llevado a las IAs a obtener una determinada conclusión

Eso si, con esta última afirmación estoy totalmente de acuerdo: